美国可以从英国和欧盟关于人工智能的监管中学到什么 媒体

加州人工智能安全法案的否决及其启示

关键要点

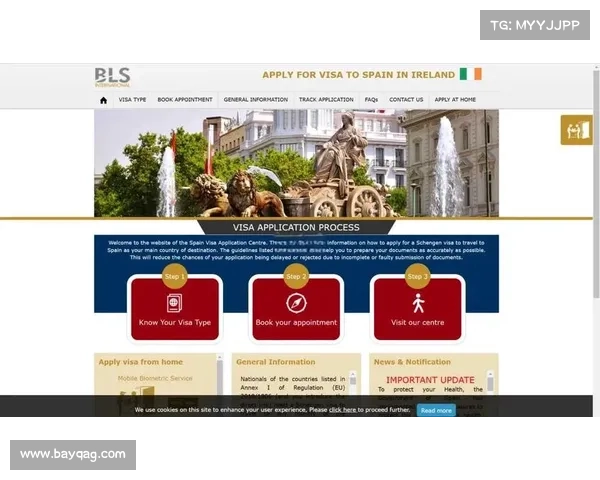

加州州长加文纽瑟姆最近否决了一项重要的人工智能法案,此法案旨在规管技术公司对其AI模型可能造成的伤害负责。尽管法案意图良好,但其“一刀切”的监管方法可能导致过于严格,而忽视了风险较低的AI应用。英国和欧盟在人工智能法规方面已经走在前面,强调高风险AI应用的区分。美国可向这两个地区学习,制定更具针对性的法规,保证公众信任并促进行业创新。加州州长加文纽瑟姆上个月否决了一项被认为是美国迄今为止最重要的人工智能立法的法案。这项法案旨在为技术公司设定法律责任,以规管这些公司的AI模型所带来的潜在危害。法案要求企业对强大的AI模型进行安全测试,并强制要求技术公司为AI技术设立“紧急停止开关”,以防止技术滥用。

纽瑟姆指出,该法案尽管有其合理的初衷,但其采用了一种过于宽泛的方法,对所有大型模型施加统一的监管,而未能区分高风险AI应用与风险较低的应用。

他进一步强调,该法案关注那些大型、成本高昂的AI模型,可能会给公众造成一种虚假的安全感,因为只专注于高成本系统。那些较小、更具专业性的AI模型同样可能存在相等甚至更大的风险,但并未得到足够的关注。此外,该法案对所有大型模型实施严格的安全协议,无论这些模型是否在高风险环境中使用或处理敏感数据。因此,纽瑟姆担心,该法案可能创造出一个过于限制的环境,从而抑制创新。

该法案及纽瑟姆的否决决定引发了广泛的关于如何有效监管AI的辩论,特别是在如何减少风险与不扼杀创新之间取得平衡。英国和欧盟也在积极探索不同的方法来应对这一问题。

AI法规的考虑因素

相较于美国,英国和欧盟在其监管努力上走得更远。这两个地区的法规强调区分高风险应用,无论使用大型模型还是较小的专用模型。例如,在基尔斯塔默领导下,英国推动了一个以安全为核心的AI监管框架,旨在通过增强透明度、人工监督和数据质量标准来防止滥用,尤其集中在医疗和刑事司法等高风险领域。

这一方法与欧盟的AI法案紧密相连,后者同样对高风险AI应用施加合规要求,如医疗、金融和公共服务领域的应用。欧盟AI法案禁止任何引发“不可接受风险水平”的AI系统,包括社交评分算法。英国和欧盟都意识到在关键领域中构建公众对AI信任的重要性,其监管框架旨在确保AI系统是可解释的、可靠的和公平的。

尽管英国和欧盟的监管旨在降低风险,但仍有顾虑认为这种严格的方法可能抑制创新,尤其是对于小型公司而言。合规成本可能成为初创公司的负担,从而限制前沿AI技术的发展。

美国的启示

目前,美国尚缺乏全面的联邦AI监管,可借鉴英国和欧盟的一些经验教训。首先,欧洲的法规基于AI系统所构成的实际风险。英国和欧盟在严格监管高风险AI系统的同时,也允许低风险应用更多的灵活性。这种针对性的监管方法能够避免因过度监管而扼杀创新,这是纽瑟姆在其否决中提到的一个主要关注点。

此外,强调透明度、人工监督和责任感的监管模型为美国建立AI治理提供了方向。确保AI系统的可解释性和责任感对公众信任至关重要,特别是在这些技术越来越多地融入日常生活的情况下。

快喵加速器下载英国采用的另一个策略,是建立监管试验场regulatory sandboxes,这种环境允许科技公司在受控的环境中